Trong thế giới GPU hiệu năng cao hiện nay, có thể nói thị trường gần như là cuộc chơi giữa hai cái tên: Nvidia và AMD. Cả hai đều là những tập đoàn bán dẫn hàng đầu, cung cấp GPU cho gaming, workstation và trung tâm dữ liệu.

Nhưng khi bước vào lĩnh vực AI và Deep Learning, cán cân rõ ràng đang nghiêng về Nvidia.

Tổng quan hai ông lớn GPU

Trong gaming, hai hãng cạnh tranh khá cân bằng. Nhưng trong AI, Nvidia đang dẫn trước một khoảng cách đáng kể.

1. CUDA vs ROCm – Khác biệt nằm ở hệ sinh thái

CUDA – Chuẩn thực tế của ngành AI

CUDA (Compute Unified Device Architecture) là nền tảng lập trình song song độc quyền của Nvidia.

Điểm mạnh của CUDA:

Trong thực tế, hầu hết code AI hiện nay mặc định chạy trên CUDA. Điều này tạo ra một lợi thế cực lớn cho Nvidia: chuẩn công nghiệp.

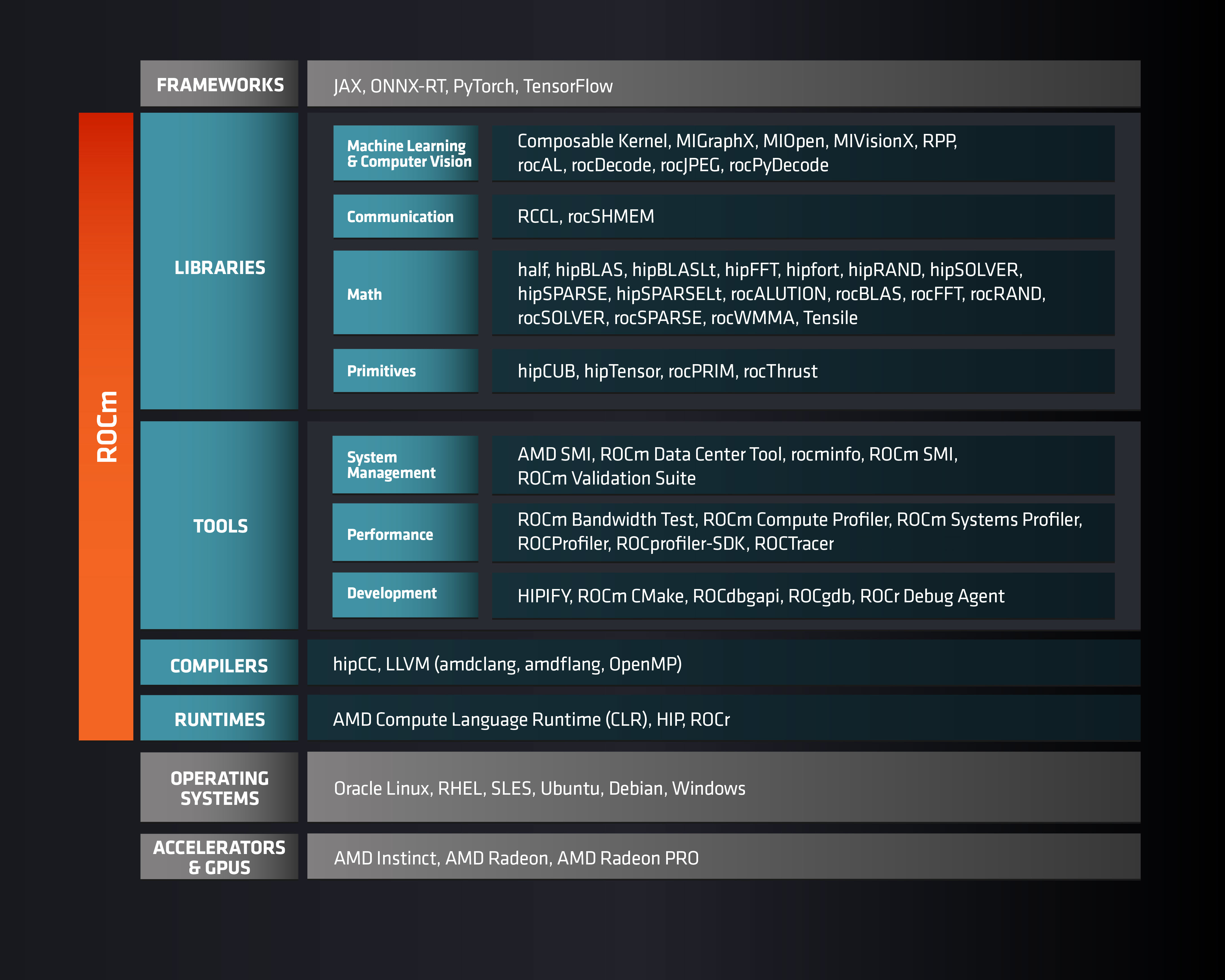

ROCm – Nỗ lực của AMD

ROCm (Radeon Open Compute) là nền tảng mã nguồn mở của AMD nhằm cạnh tranh với CUDA.

Ưu điểm:

Nhược điểm:

Kết luận ở cấp độ nền tảng phần mềm:

👉 Nvidia đang dẫn trước AMD nhiều năm.

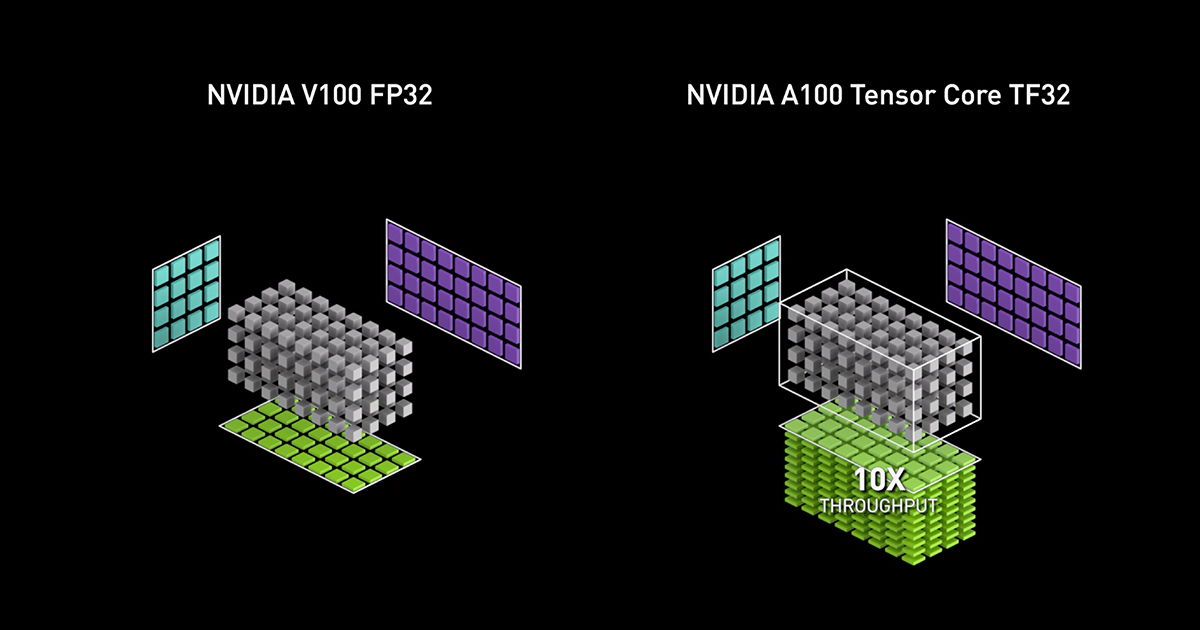

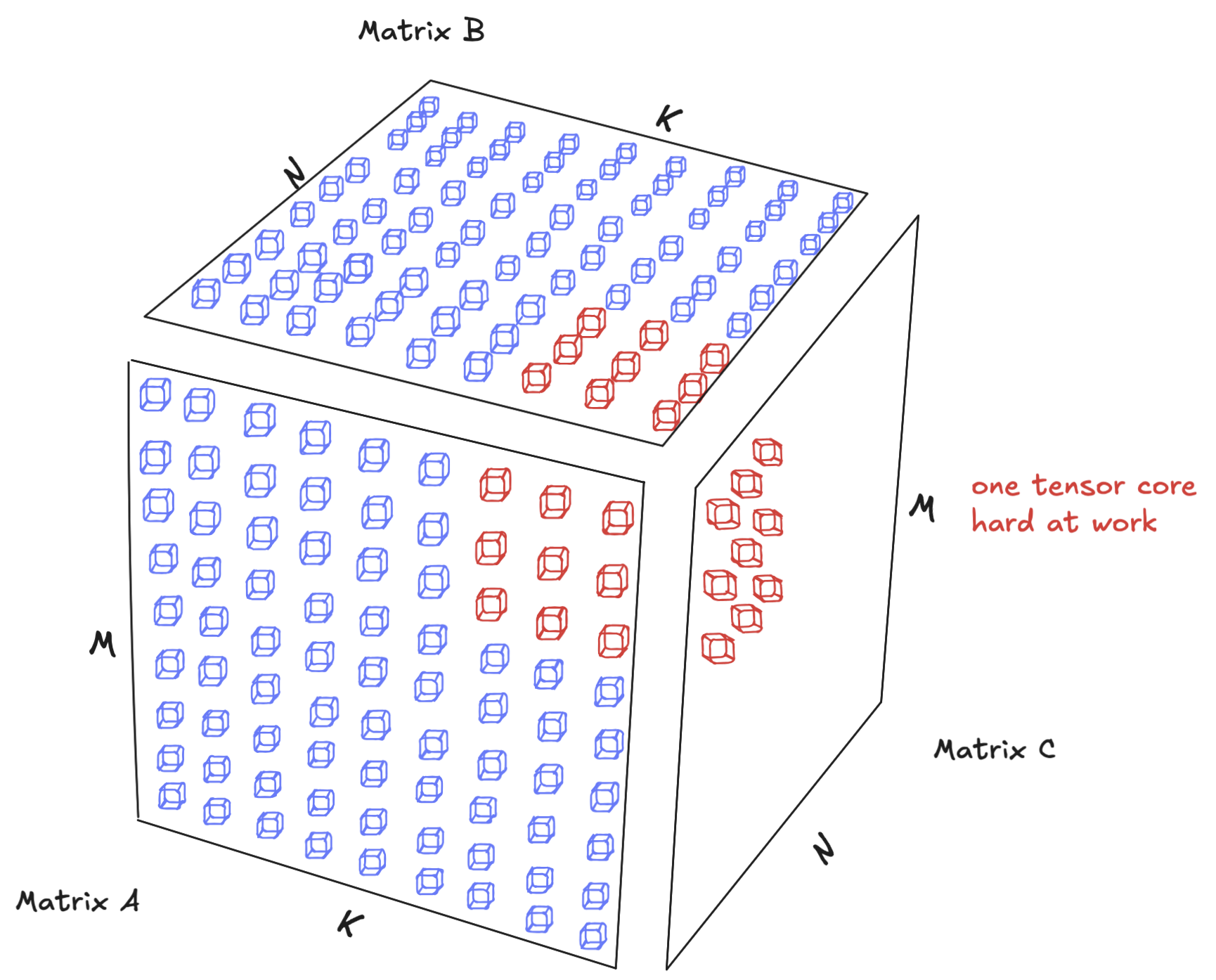

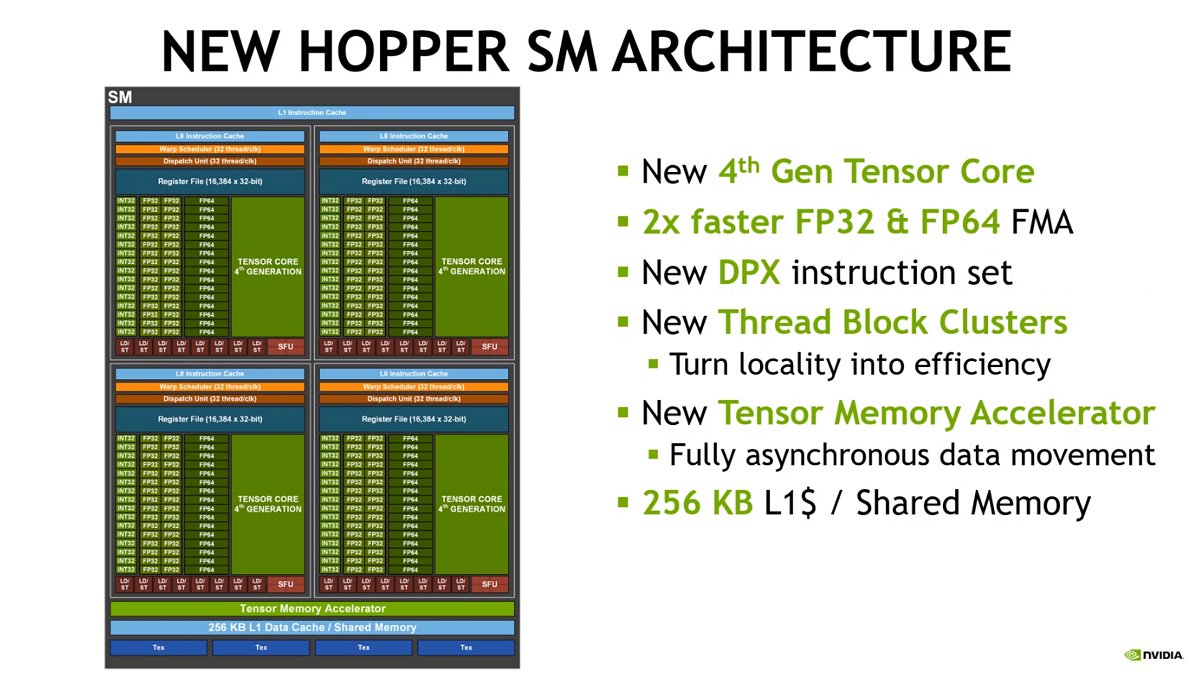

2. Tensor Core vs RDNA/CDNA – Sức mạnh phần cứng AI

Tensor Core – Vũ khí chuyên dụng cho Deep Learning

Tensor Core là phần cứng chuyên xử lý nhân ma trận – trái tim của deep learning.

Ưu điểm:

Điều này giúp GPU Nvidia thống trị các workload như:

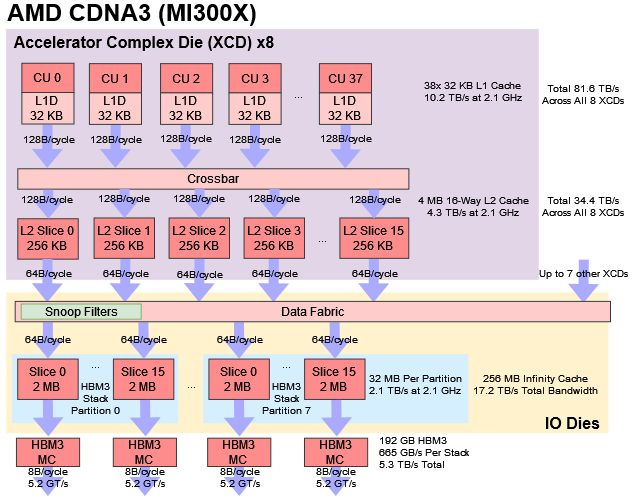

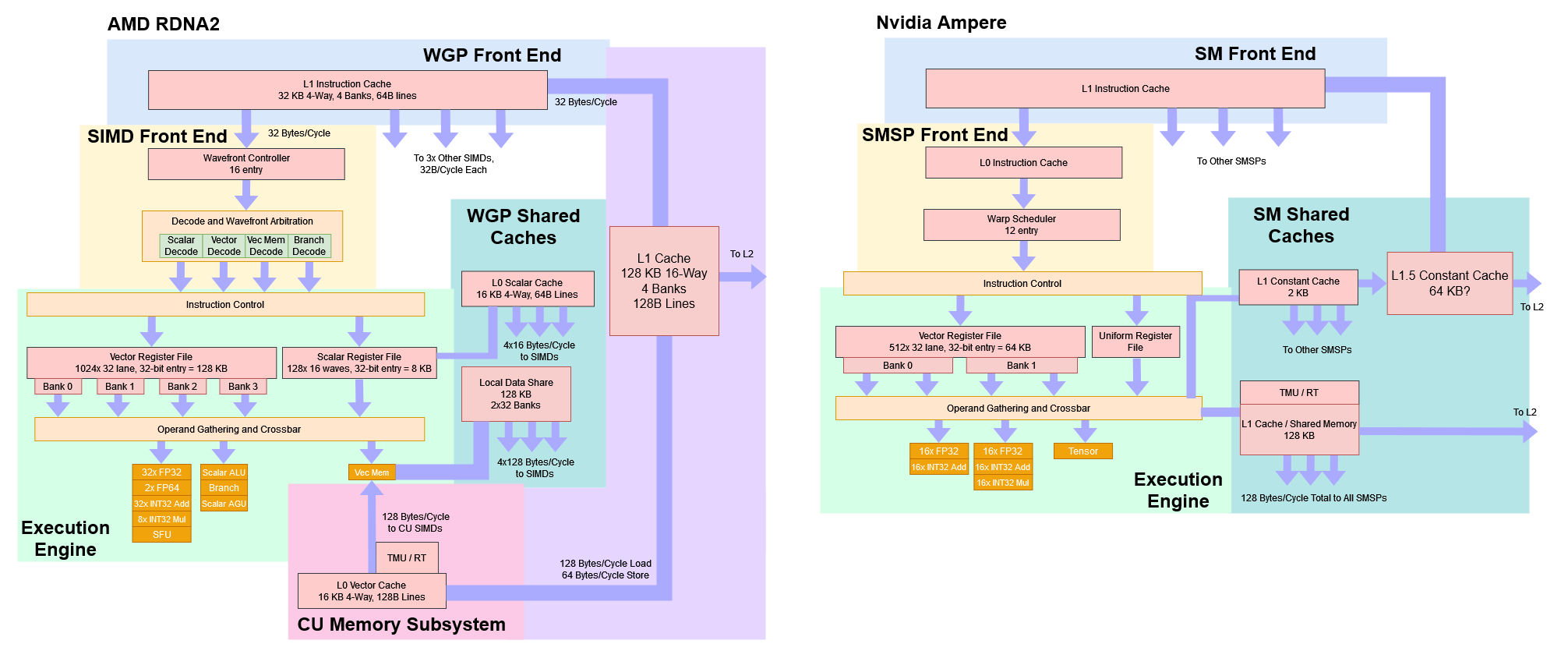

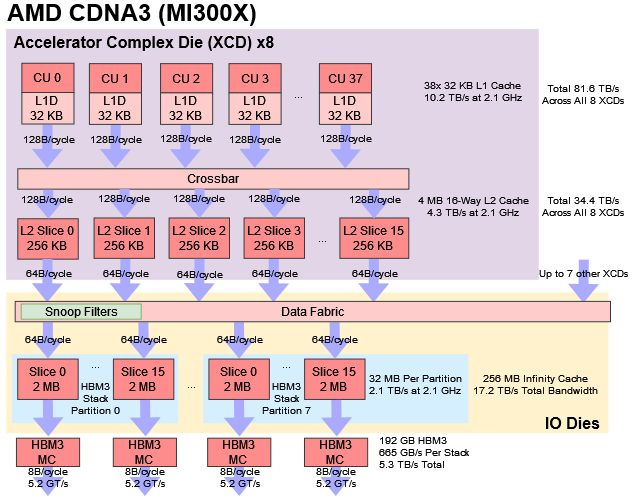

RDNA và CDNA – Kiến trúc của AMD

AMD sử dụng:

CDNA có Matrix Core tương tự Tensor Core, nhưng:

Trong benchmark AI thực tế ở quy mô lớn, Nvidia vẫn chiếm ưu thế về độ ổn định và hiệu năng tổng thể.

3. Lợi thế chiến lược: Nvidia bán nền tảng, AMD bán phần cứng

Nvidia không chỉ bán GPU. Họ cung cấp:

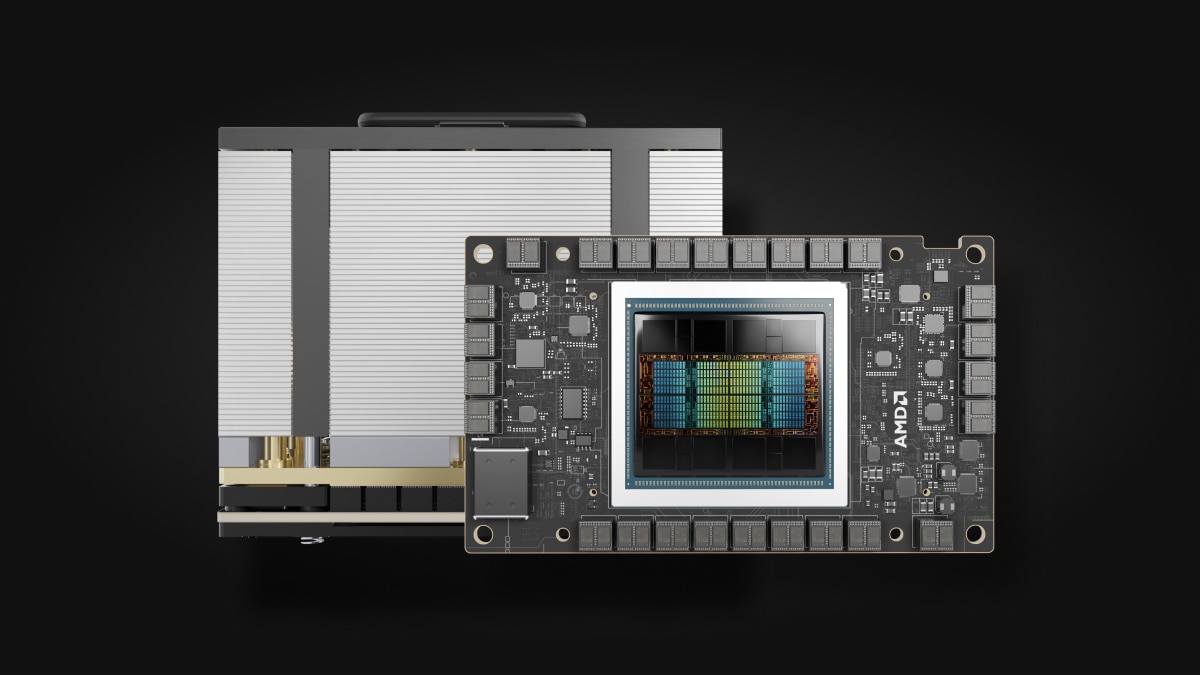

AMD mạnh về CPU + GPU tích hợp (EPYC + Instinct), nhưng hệ sinh thái AI của họ vẫn đang trong giai đoạn xây dựng.

Trong khi đó, Nvidia đã trở thành:

4. Vì sao Nvidia thực sự ưu việt hơn AMD trong AI?

Tổng hợp các yếu tố: 1️⃣ Đi trước hơn một thập kỷ

CUDA ra đời từ 2006. 2️⃣ Hệ sinh thái gần như không thể thay thế

Framework AI tối ưu mặc định cho Nvidia. 3️⃣ Tensor Core vượt trội trong deep learning

Thiết kế phần cứng tập trung hoàn toàn cho AI. 4️⃣ Độ phổ biến toàn cầu

Hầu hết trung tâm dữ liệu AI lớn đều dùng Nvidia.

Kết luận

Trong cuộc chơi GPU AI toàn cầu hiện nay, chỉ có hai đối thủ lớn: Nvidia và AMD.

AMD đang tiến bộ nhanh và có tiềm năng dài hạn. Tuy nhiên, ở thời điểm hiện tại:

Sự vượt trội của Nvidia đến từ sự kết hợp giữa:

Và trong lĩnh vực AI, hệ sinh thái quan trọng hơn cả silicon.

Nhưng khi bước vào lĩnh vực AI và Deep Learning, cán cân rõ ràng đang nghiêng về Nvidia.

Tổng quan hai ông lớn GPU

- Nvidia – thành lập năm 1993, tiên phong trong GPU song song và điện toán tăng tốc.

- AMD – thành lập năm 1969, nổi tiếng với CPU Ryzen và EPYC, đồng thời là đối thủ trực tiếp của Nvidia trong mảng GPU.

Trong gaming, hai hãng cạnh tranh khá cân bằng. Nhưng trong AI, Nvidia đang dẫn trước một khoảng cách đáng kể.

1. CUDA vs ROCm – Khác biệt nằm ở hệ sinh thái

CUDA – Chuẩn thực tế của ngành AI

CUDA (Compute Unified Device Architecture) là nền tảng lập trình song song độc quyền của Nvidia.

Điểm mạnh của CUDA:

- Hơn 15 năm phát triển và tối ưu

- Hệ sinh thái thư viện đồ sộ (cuDNN, cuBLAS, TensorRT)

- Tích hợp sâu với:

- PyTorch

- TensorFlow

Trong thực tế, hầu hết code AI hiện nay mặc định chạy trên CUDA. Điều này tạo ra một lợi thế cực lớn cho Nvidia: chuẩn công nghiệp.

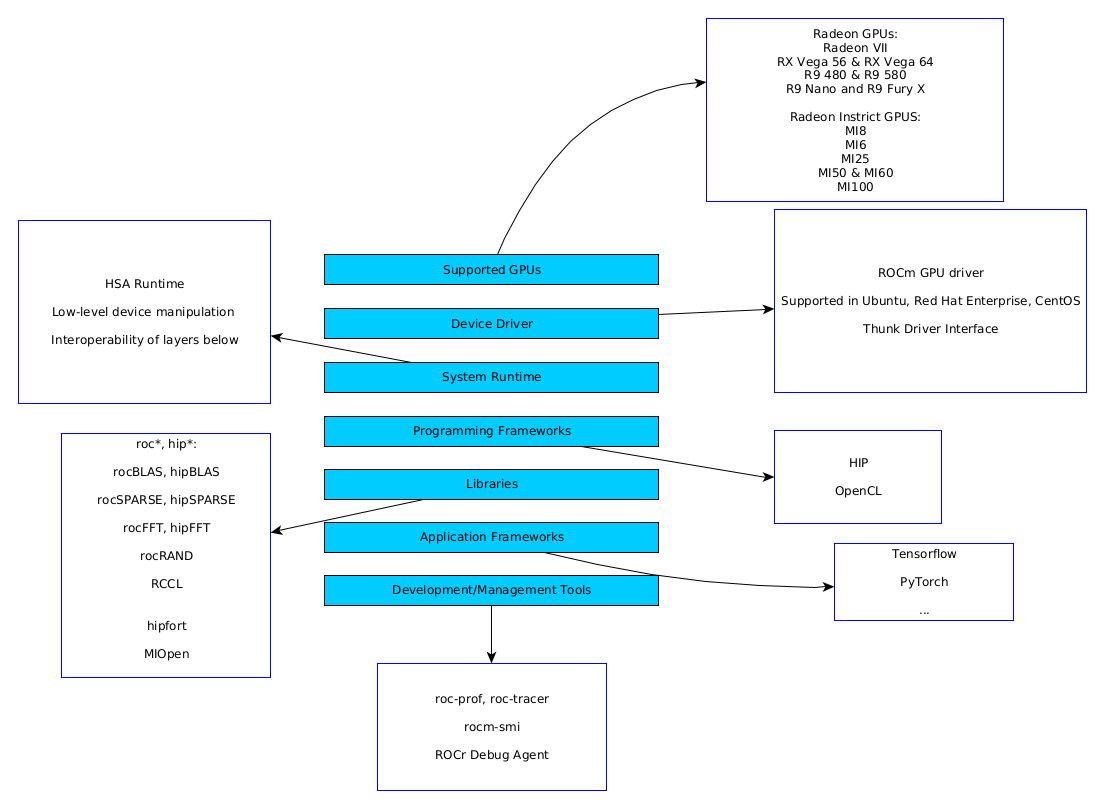

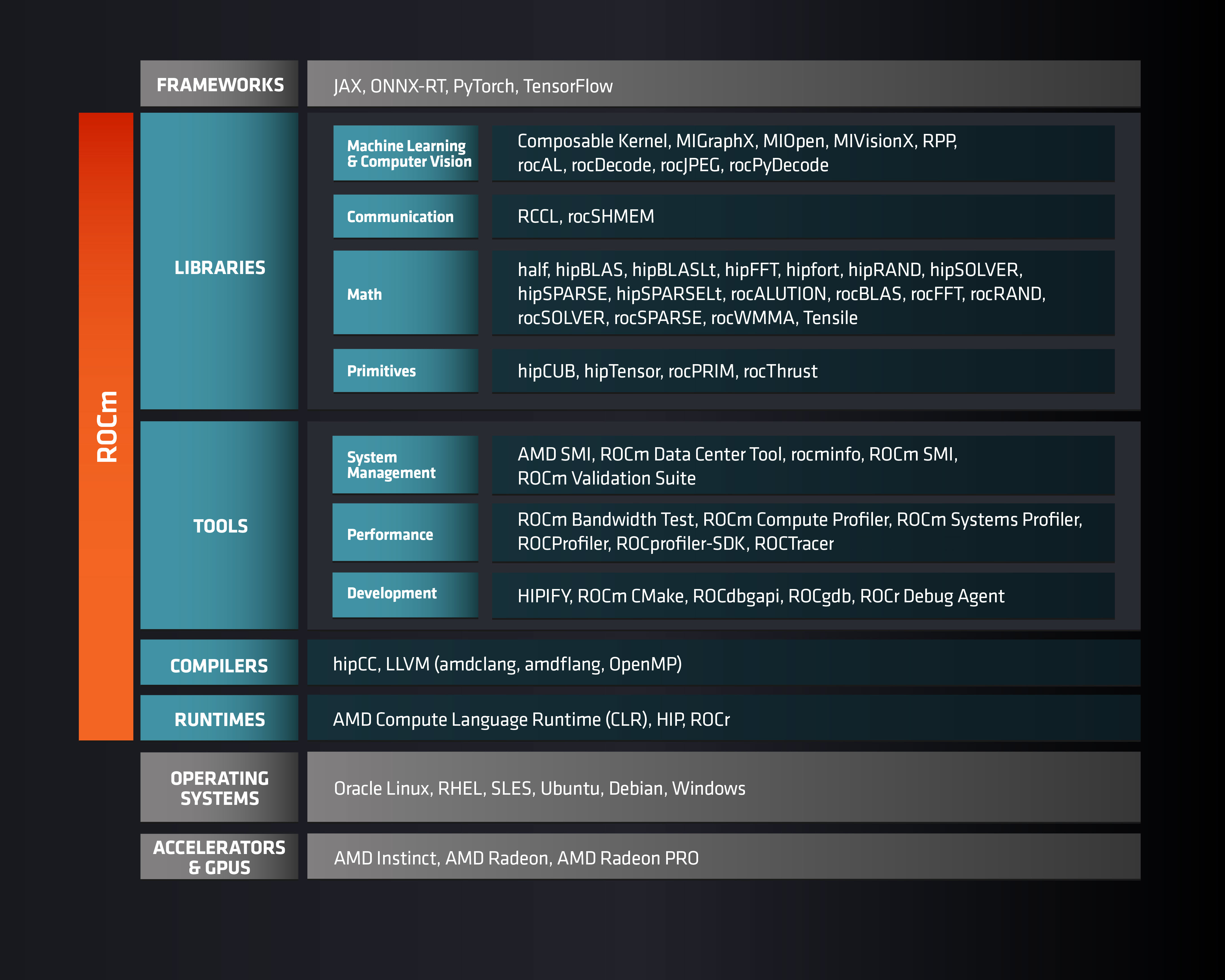

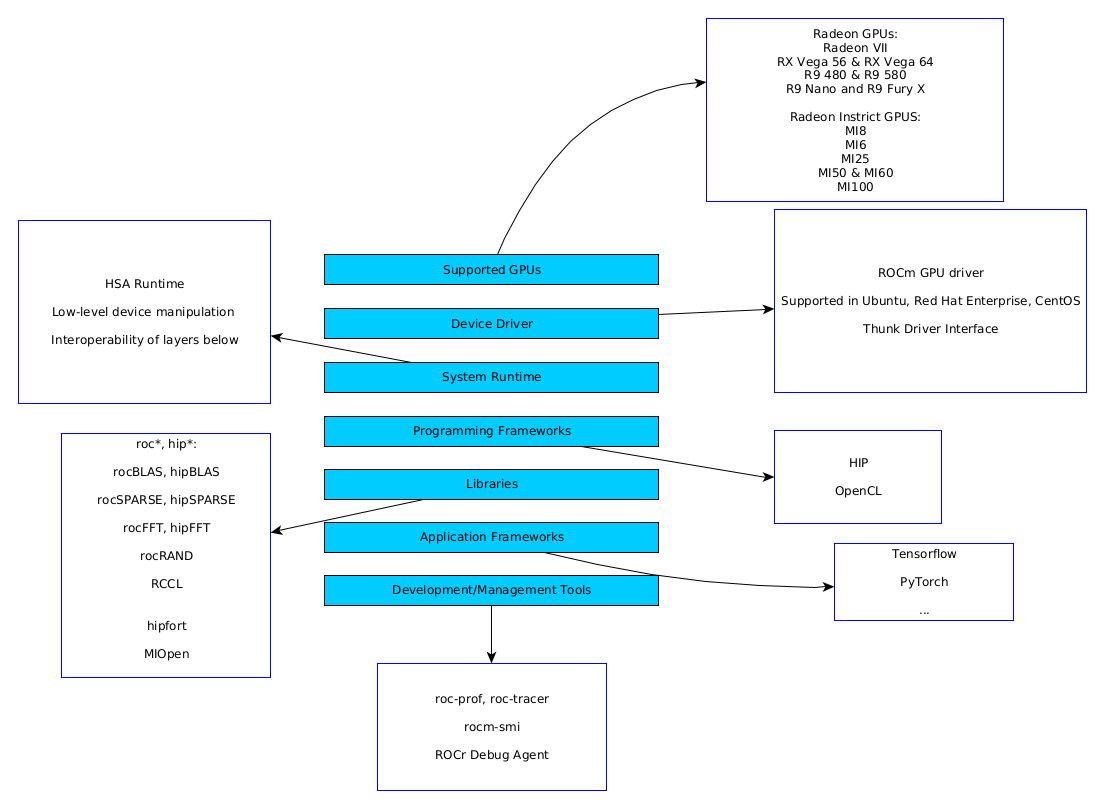

ROCm – Nỗ lực của AMD

ROCm (Radeon Open Compute) là nền tảng mã nguồn mở của AMD nhằm cạnh tranh với CUDA.

Ưu điểm:

- Mã nguồn mở

- Có thể port CUDA sang HIP

- Đang được cải thiện nhanh

Nhược điểm:

- Hệ sinh thái nhỏ hơn

- Ít thư viện tối ưu sâu

- Cộng đồng nhỏ hơn nhiều so với CUDA

Kết luận ở cấp độ nền tảng phần mềm:

👉 Nvidia đang dẫn trước AMD nhiều năm.

2. Tensor Core vs RDNA/CDNA – Sức mạnh phần cứng AI

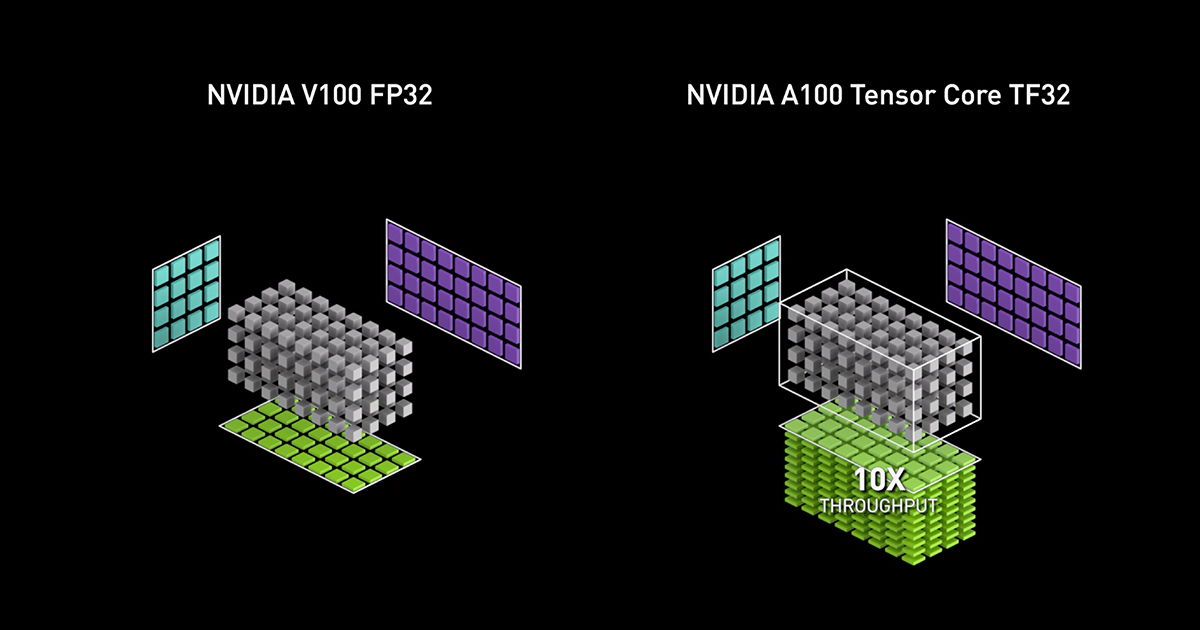

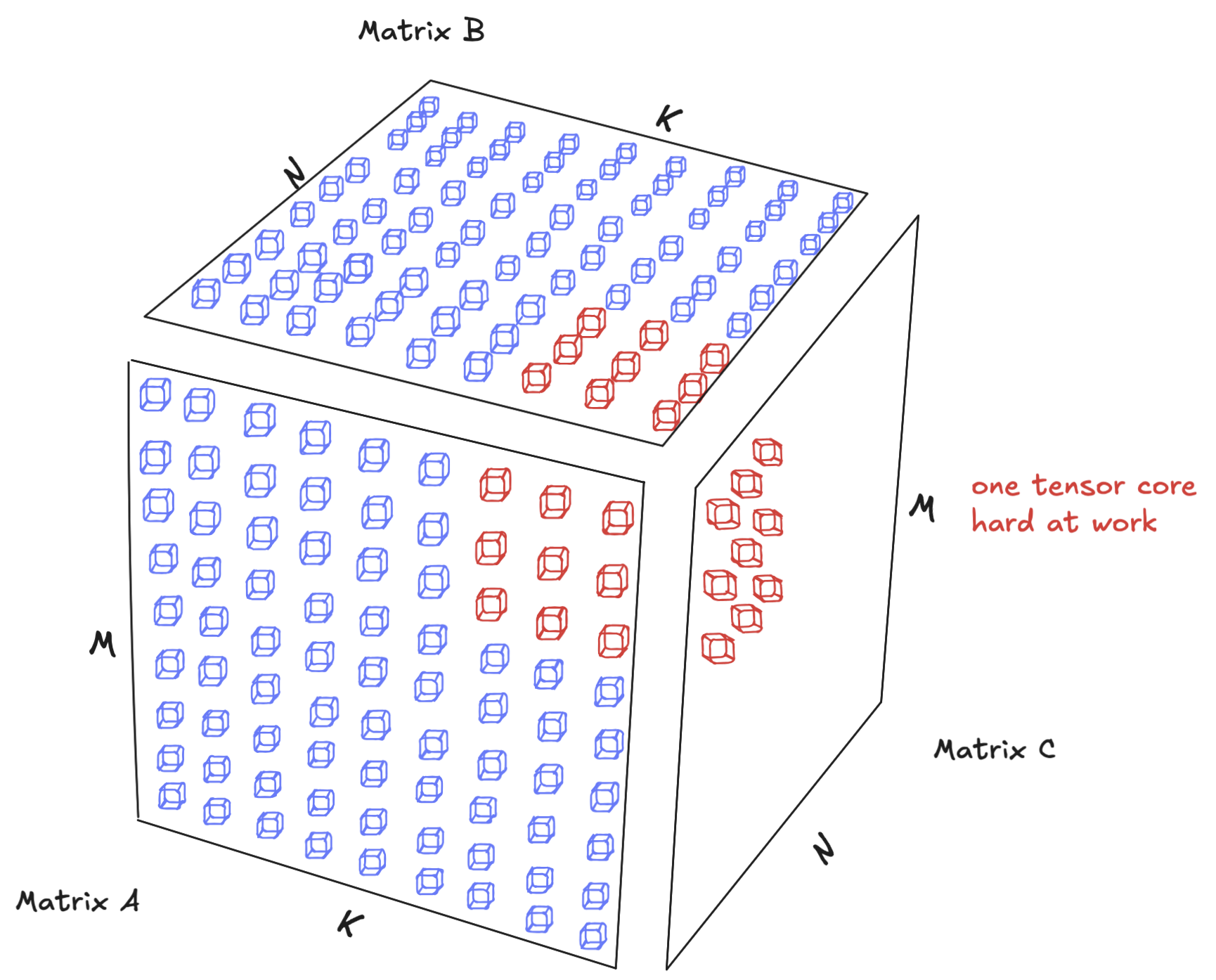

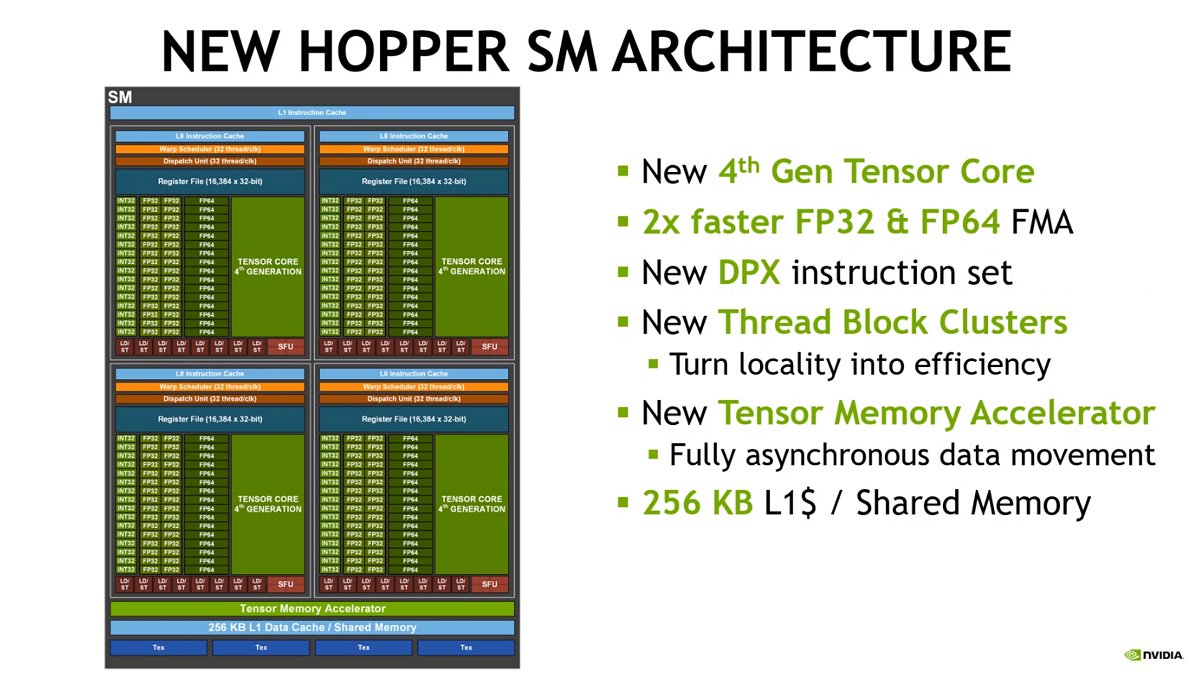

Tensor Core – Vũ khí chuyên dụng cho Deep Learning

Tensor Core là phần cứng chuyên xử lý nhân ma trận – trái tim của deep learning.

Ưu điểm:

- Tăng tốc FP16, BF16, INT8

- Hiệu suất training vượt trội

- Tối ưu cho transformer và LLM

Điều này giúp GPU Nvidia thống trị các workload như:

- Huấn luyện mô hình ngôn ngữ lớn

- Computer vision

- AI tạo sinh

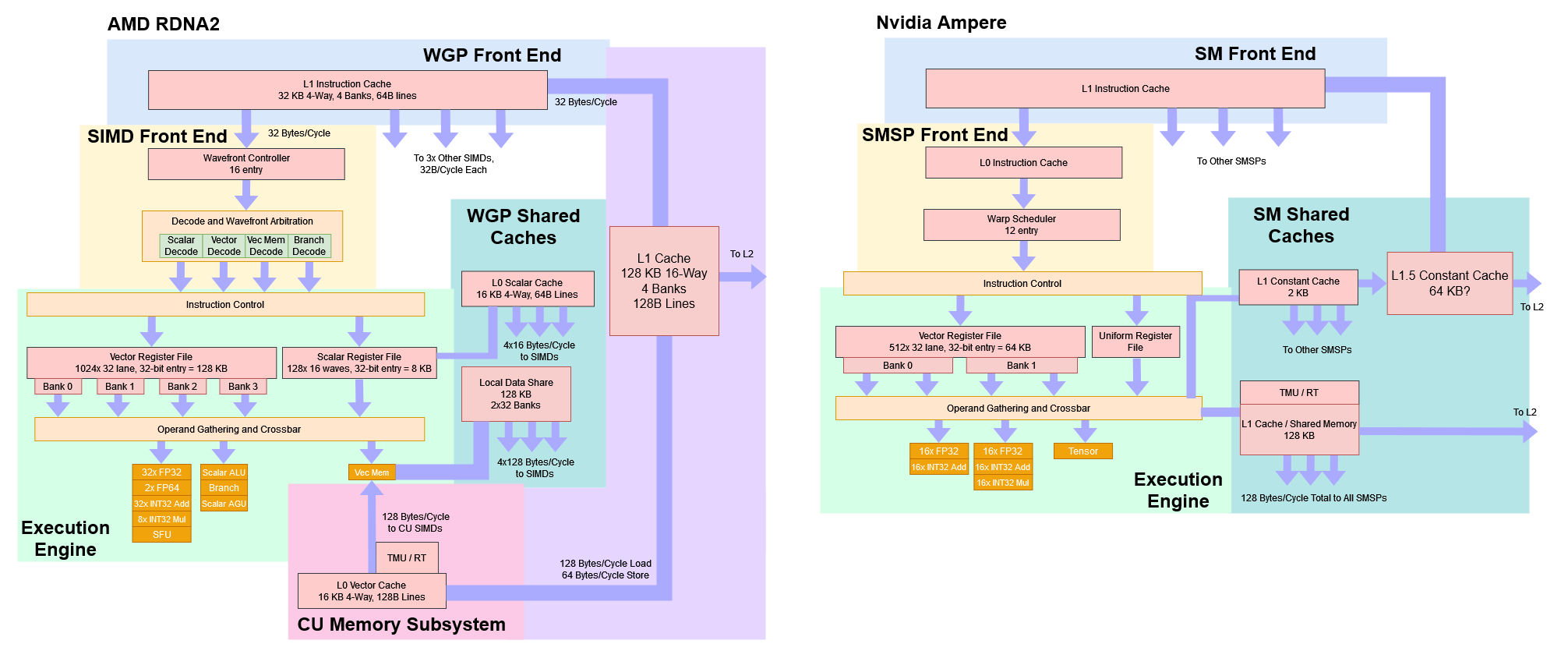

RDNA và CDNA – Kiến trúc của AMD

AMD sử dụng:

- RDNA cho gaming

- CDNA cho compute và AI (dòng Instinct)

CDNA có Matrix Core tương tự Tensor Core, nhưng:

- Ra đời muộn hơn

- Chưa được tối ưu rộng rãi bằng

- Phần mềm hỗ trợ chưa sâu

Trong benchmark AI thực tế ở quy mô lớn, Nvidia vẫn chiếm ưu thế về độ ổn định và hiệu năng tổng thể.

3. Lợi thế chiến lược: Nvidia bán nền tảng, AMD bán phần cứng

Nvidia không chỉ bán GPU. Họ cung cấp:

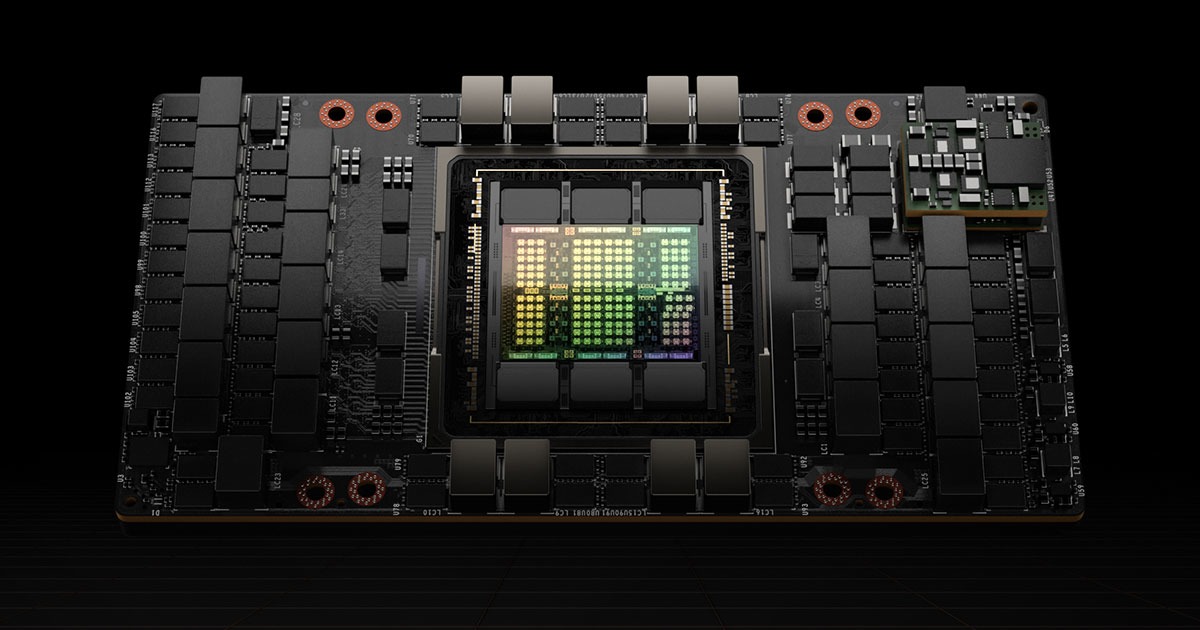

- Phần cứng (H100, A100, DGX)

- Phần mềm (CUDA stack)

- Giải pháp AI trọn gói

- Hợp tác sâu với cloud hyperscaler

AMD mạnh về CPU + GPU tích hợp (EPYC + Instinct), nhưng hệ sinh thái AI của họ vẫn đang trong giai đoạn xây dựng.

Trong khi đó, Nvidia đã trở thành:

Chuẩn hạ tầng AI cho startup, enterprise và cloud toàn cầu.

4. Vì sao Nvidia thực sự ưu việt hơn AMD trong AI?

Tổng hợp các yếu tố: 1️⃣ Đi trước hơn một thập kỷ

CUDA ra đời từ 2006. 2️⃣ Hệ sinh thái gần như không thể thay thế

Framework AI tối ưu mặc định cho Nvidia. 3️⃣ Tensor Core vượt trội trong deep learning

Thiết kế phần cứng tập trung hoàn toàn cho AI. 4️⃣ Độ phổ biến toàn cầu

Hầu hết trung tâm dữ liệu AI lớn đều dùng Nvidia.

Kết luận

Trong cuộc chơi GPU AI toàn cầu hiện nay, chỉ có hai đối thủ lớn: Nvidia và AMD.

AMD đang tiến bộ nhanh và có tiềm năng dài hạn. Tuy nhiên, ở thời điểm hiện tại:

Nvidia không chỉ dẫn đầu — mà đang thiết lập tiêu chuẩn cho toàn ngành AI.

Sự vượt trội của Nvidia đến từ sự kết hợp giữa:

- Kiến trúc phần cứng chuyên biệt

- Nền tảng phần mềm trưởng thành

- Hệ sinh thái khổng lồ

- Chiến lược dài hạn tập trung vào AI

Và trong lĩnh vực AI, hệ sinh thái quan trọng hơn cả silicon.